●掌握智能化作戰體系的脆弱性特征,宛如洞悉對手的“阿喀琉斯之踵”,通過有針對性的攻擊與反制,能夠贏得智能對抗的先機

作戰體系是各種作戰系統按照一定的指揮關系、組織關系和運行機制構成的有機整體。與傳統信息化作戰體系相比,智能化作戰體系呈現出自主、多維、韌性等新反脆弱性特性,魯棒性得到極大提高。但是,從支撐技術、運行機理等視角看,智能化作戰體系仍然存在較為顯著的脆弱性,是破壞敵體系有效運行,形成相對智能優勢,進而奪取制智權的關鍵所在。

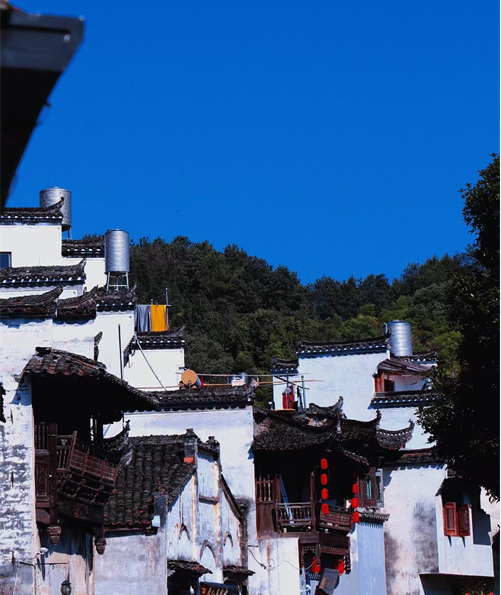

(資料圖)

(資料圖)

支撐技術視角:固有缺陷無法避免

系統驅動過分依賴數據。基于深度神經網絡的主流軍事智能技術,是一種數據驅動模型,即使用海量標記樣本來訓練、擬合出智能決策模型,數據測試合格后,再部署到實際環境中應用。它并未像人一樣理解學習樣本真實含義,只不過恰好構建了一個在預設訓練集上運行良好的模型。由此構建的智能模型對原始數據輕微擾動具有非線性放大效應,一旦出現了預測空間之外的樣本,即不良甚至錯誤數據,就可能崩潰,作出錯誤決策,導致決策災難。

決策模型適應性偏弱。隨著技術發展,人工智能技術難點已從數據邊界轉為決策邊界。軍事人工智能模型的算法構造和參數設定,天然地依賴于領域知識并受限于有限的數據集空間,須滿足確定性信息、完全信息、有限領域等條件,是完全信息博弈。但是,軍事決策環境恰好是典型的非完全信息博弈。此外,模型的訓練、測試數據與知識范圍均基于已有案例產生,但軍事決策的對抗性決定了新的決策結論往往與既往相似決策環境中的結論存在差異甚至截然相反,智能模型尚不能夠有效產生這種出乎意料、合乎作戰藝術之中的決策結論。

算法“不可解釋”會衍生風險。作為特殊對抗活動,軍事智能系統的決策過程應當具備“可解釋性”,也就是人能夠理解智能算法決策邏輯過程與結果。但是,當前人工智能系統算法呈現“黑箱”特征,人無法了解并掌握它的決策過程,初始條件、權重等簡單參數的微小變化和調整,可能產生復雜的結果。這意味著智能系統存在著結構性漏洞,存在不可預知的決策風險,極可能產生錯誤甚至危險決策。同時,這還導致軍事智能系統的數據、算法、模型等可能存在難以發現的后門或漏洞,無法預知系統安全風險。

運行機理視角:體系控制難度放大

多域交互產生認知失真。智能化作戰體系分布于物理域、聯通于信息域、角逐于認知域,作戰過程中,數據、信號、指令等信息跨域傳遞,人腦、機腦認知結果多次交互,一組信息需要歷經多輪交叉映射,數據失真進而產生信息受損不可避免。

復雜結構導致控制困難。器件小型化、系統集成化,是智能化武器裝備平臺的典型特征。系統內部器件的小型化使得器件抗毀性、信號完整性受到挑戰,相鄰器件還可能相互影響造成信號干擾和信息泄露。集成的各子系統之間依靠各類傳感器、網絡交換元器件和系統通信協議等聯結形成新的系統,結構繁復,控制信號難以流暢傳遞。在此基礎上疊加無序的人員意識、錯綜復雜的關系與機制等要素,進一步放大了這種控制困難。

體系演化加劇不確定性。如果將智能化作戰體系視為復雜巨系統,除了系統穩定依賴少數關鍵節點、作戰鏈路易損易毀等復雜系統共同脆弱性等外,作戰體系還存在著涌現性機制不清楚的薄弱環節,即系統知道1+1>2,但是等于幾不知道。傳統作戰體系可通過人的活動來有意識地控制體系演化方向。但是,智能化作戰體系的顯著特征就是自主性極大增強,除少數關鍵活動有人介入外,大部分活動均是“人在回路上”,這就導致體系的自主演化方向不可控,既可以趨于穩定,也可能趨向崩潰。

人機協同視角:人機關系難以平衡

人機難以徹底信任。智能化作戰體系中,各級指揮機構人機協同,人腦+機腦共同構成指揮主體。作戰過程中,除人腦指令外,各級還要貫徹執行機腦下達的指令。受人工智能技術缺陷、決策過程“黑箱”、人的主觀意識等因素影響,人很難無條件地信任并接受機器決策結果。這種不信任感可以通過長期人機協同訓練降低,但是無法絕對消除。在戰場態勢發展的關鍵時刻,一旦人和機器的決策結果發生分歧,勢必影響決策速度與質量。

戰爭倫理無法回避。在未來智能化作戰系統中,無論人、機以何種模式共存,人工智能系統的機腦都將獲取部分指揮控制權限。但是,戰爭活動有其特殊性,它直接帶來人的流血與死亡。按照“機器人三定律”,機器人不能對人造成傷害。但是,未來智能化戰爭,軍事智能系統的決策與行動,勢必造成人類的傷亡。軍事智能系統是否擁有對人攻擊的權限,其決策權限邊界在哪里,濫用這種權限是否導致機器人尋求主動傷害人類等,一直是科學界爭論的焦點,也是當前各國發展軍事人工智能無法回避的問題。(顧靜超 張永亮 王光雷)

關鍵詞:

營業執照公示信息

營業執照公示信息